人工智能幻觉是指人工智能模型,特别是大型语言模型(LLM)生成看似真实但不正确或与输入无关的信息的情况。这种现象带来了重大挑战,因为它可能导致虚假或误导性信息的传播。

这些幻觉不是随机错误,而是通常由以下原因引起:

- 训练模型的数据之间的复杂交互,

- 模型的设计,

- 模型如何解释提示。

因此,解决人工智能幻觉对于人工智能系统的可靠性和可信度至关重要。这对于需要准确性和事实正确性的应用程序至关重要。让我们更详细地了解这一点。

人工智能幻觉的原因

人工智能幻觉可能源于多种因素,例如:

由于训练数据不佳而导致人工智能误解

训练数据的质量、多样性和代表性会影响人工智能模型解释和响应输入的方式。训练数据不充分或有偏差可能会导致人工智能模型生成错误或误导性的输出。 选择正确的训练数据至关重要 确保模型对主题有平衡且全面的理解。

过度拟合导致的机器学习错误

当人工智能模型在受限数据集上进行训练时,就会发生过度拟合。它使模型记住特定的输入和输出,而不是学习泛化。这种泛化能力的缺乏会导致模型在遇到新数据时产生幻觉。

AI 解读成语或俚语错误

人工智能模型可能会遇到训练数据中没有遇到过的习语或俚语。这种不熟悉可能会导致 AI 输出异常。

对抗性攻击导致人工智能数据失真

涉及故意设计误导或迷惑人工智能的提示的对抗性攻击可能会引发幻觉。这些攻击利用了模型的设计和训练漏洞。

不良提示工程

如何构建和向人工智能模型呈现提示会显着影响其输出。模糊或不明确的提示可能会导致模型产生幻觉或产生不相关或不正确的信息。相反,提供清晰上下文和方向的结构良好的提示可以指导模型生成更准确和相关的响应。

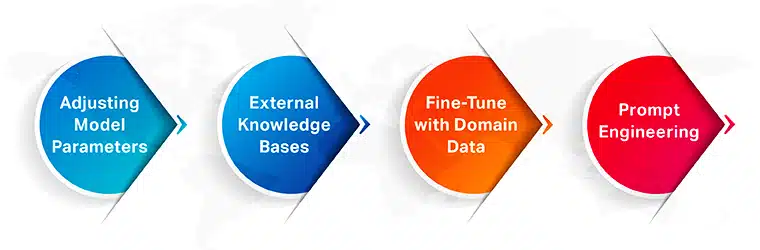

减少人工智能幻觉的技术

减少人工智能模型(尤其是大型语言模型)中的幻觉涉及技术策略的组合:

调整模型参数

将温度参数设置为 0 可以得到更准确的结果。温度控制模型响应生成的随机性。较低的温度意味着模型可以选择最可能的单词和短语,以获得更可预测和更可靠的输出。这种调整对于需要事实准确性和一致性的任务尤其有价值。

外部知识库

利用外部数据源进行验证可以显着减少生成错误。它可以在生成响应时通过向模型提供最新且经过验证的信息来引用此外部数据。这种方法将纯粹的生成问题转化为基于所提供数据的更直接的搜索或总结任务。

Perplexity.ai 和 You.com 等工具通过将 LLM 输出与 多样化的数据 从外部来源检索。

使用特定领域的数据进行微调

使用特定领域的数据训练模型可以提高其准确性并减少幻觉。此过程将模型暴露给与特定领域或主题相关的模式和示例。这样,您可以将其输出与目标域对齐。

这种微调使模型能够生成更适合上下文的准确响应。它在医学、法律或金融等专业应用中至关重要。

即时工程

提示的设计对于减轻幻觉起着关键作用。清晰、上下文丰富的提示可以更有效地指导人工智能模型。它们可以减少人工智能的误解和歧义,并指导模型生成相关且准确的响应。

如果您明确指定信息需求并提供必要的上下文,您的模型就不太可能产生不相关或不正确的输出。

减轻幻觉的高级策略

您可以利用三种高级方法来减少大型语言模型中的 AI 幻觉,其中包括:

检索增强生成 (RAG)

该方法将法学硕士的生成能力与充当知识库的矢量数据库相结合。当输入查询时,模型将其转换为语义向量并检索具有相似向量的文档。

然后,法学硕士使用这些文档和原始查询来生成更准确且与上下文相关的响应。 RAG 本质上为 LLM 提供了以下形式: 长期记忆。这使得法学硕士能够访问和集成外部数据。

思维链提示推理

由于变压器的进步,法学硕士擅长单词预测、信息总结和数据提取等任务。他们还可以进行规划和复杂的推理。

思维链提示有助于法学硕士将多步骤问题分解为更易于管理的步骤。它提高了他们解决复杂推理任务的能力。通过合并矢量数据库中的示例来增强该方法,该数据库为法学硕士提供了可供借鉴的额外背景和示例。由此产生的答案是准确的,并包含其背后的推理,并进一步存储在矢量数据库中以改进未来的响应。

迭代查询

此过程涉及人工智能代理,以促进法学硕士和矢量数据库之间的迭代交互。代理用问题查询数据库,根据检索到的类似问题细化搜索,然后总结响应。

如果您发现总结的答案不满意,则重复该过程。该方法以前瞻性主动检索生成 (FLARE) 为例,通过多次迭代逐步细化查询和响应,从而提高最终答案的质量。

结论

克服人工智能模型中的幻觉需要采取多方面的方法。它必须将技术调整与高级推理策略结合起来。整合缓解方法可以显着提高人工智能响应的准确性和可靠性。这些策略解决了人工智能幻觉的直接问题,并为未来更强大、更值得信赖的人工智能系统铺平了道路。