如今,有超过 5.19 亿人探索互联网。 这是一个广大的观众,不是吗?

互联网上产生的内容数量之多简直令人震惊。 从社交媒体更新和博客文章到用户生成的评论和多媒体上传,在线世界是一个巨大且动态的信息库。

然而,并非所有内容都是好的。 有些人可能会因年龄、种族、性别、国籍或民族而冒犯不同的群体。 此类内容需要仔细观看。 这确保了每个人的和平与和谐。

因此,迫切需要内容审核。 尽管人工审核是有效的,但也存在一些我们不能忽视的局限性。 这就是自动内容审核作为有效解决方案的用武之地。 这种有效的方法可确保安全的在线体验并保护用户免受潜在的伤害。

在本文中,我们将讨论自动审核工具(使用强大的数据集进行预训练)的宝贵优势和可用的各种类型。

了解自动内容审核

自动内容审核使用技术来监督和管理用户生成的内容。 算法和机器学习不再需要人类扫描每一篇文章,而是承担繁重的工作。 他们可以快速识别有害或不适当的内容。 这些系统从大量数据集中学习,并根据人机交互预先训练的设定标准做出决策。

自动内容审核方法非常高效。 他们全天候工作并立即审查大量内容。 然而,它们也补充了人类审阅者。 有时,人性化的接触对于语境至关重要。 这种融合确保了更安全的在线空间,让用户能够两全其美。

想要一个没有有害内容的平台吗? 自动内容审核是前进的方向。 当您阅读下面的类型和好处时,我们会更清楚地说明这一点。

[另请阅读: 内容审核的必要指南]

自动审核的类型

多年来,自动内容审核已经取得了长足的发展。 它现在融合了一系列技术和方法,每种技术和方法都是为了满足特定需求而设计的。 以下是对不同类型的详细了解:

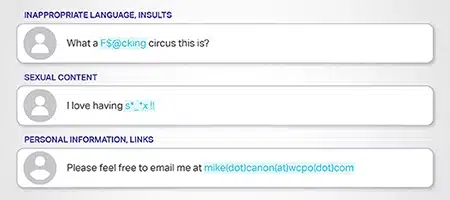

基于关键词的审核

此方法适用于预定义的禁止或标记单词列表。 当内容包含这些词时,系统要么拒绝其发布,要么将其发送以供审核。 例如,平台可能会阻止与仇恨言论相关的明确语言或术语。

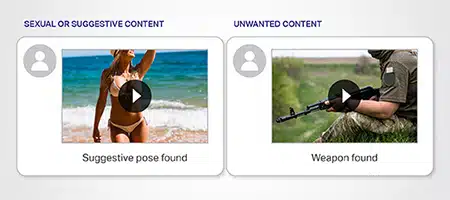

图像识别审核

该方法利用机器学习的力量,识别不适当或标记的图像。 它可以检测宣扬暴力的视觉内容、露骨内容或受版权保护的材料。 先进的算法分析视觉模式,以确保没有有害图像被忽视。

视频分析审核

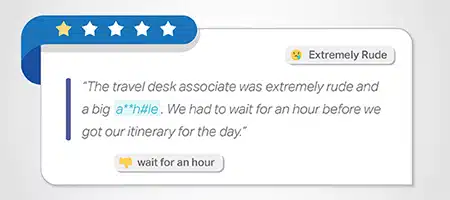

与图像识别类似,视频分析逐帧分解视频组件。 它会检查不适当的视觉效果、音频提示或标记的内容。 这对于像 YouTube 这样以视频内容为主的平台来说是无价的。情绪分析调节

理解内容背后的情绪或情感至关重要。 此方法评估内容基调并标记过于消极、宣扬仇恨或助长有害情绪的内容。 它在促进积极社区互动的论坛或平台中特别有用。

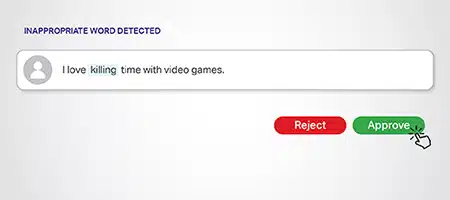

情境调节

内容通常需要上下文才能准确审核。 此方法评估其周围上下文中的内容。 如果整体上下文无害,它可以确保真实内容(即使带有标记的单词)也不会被错误地阻止。 在示例中 - 它包含“杀戮”一词,在上下文中,它是良性的,指的是玩游戏的无害活动

基于用户信誉的审核

有违反准则历史的用户可能需要受到更严格的审查。 该系统根据用户声誉进行调节。 那些有过违规行为的人可能会发现他们的内容比那些干净的人受到更严格的审查。

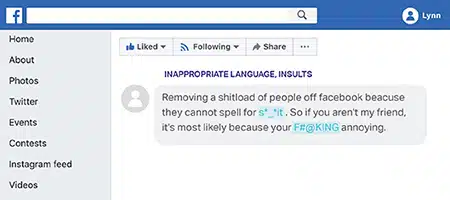

社交媒体监控审核

鉴于社交媒体上生成的大量内容,需要专门的工具来监控这些平台。 他们实时检测虚假信息、假新闻或恶意攻击等潜在问题。 它有助于创建一个更清洁、更安全的社交媒体环境。

自动审核的好处

自动化带来了各种好处。 让我们仔细看看自动内容审核提供的好处:

高效的内容过滤

随着用户生成内容 (UGC) 的激增,平台需要系统来筛选大量内容。 自动内容审核优惠 高效的内容过滤。 它确保只有合适的材料才能上市。

增强的数字安全

在线安全对于提高用户使用互联网的信任度非常重要。 自动化通过检测有害内容来帮助维护数字安全。 从仇恨言论到网络骚扰,它可以阻止此类威胁。

遵守社区准则

社区准则维护平台的完整性。 自动化可确保这些规则不被违反,并有助于创建和谐的在线空间。

打击网络骚扰和仇恨言论

自动化系统可以快速识别并消除在线骚扰和仇恨言论。 他们通过标记有害内容来确保平台保持受欢迎和安全。

解决虚假信息和假新闻

在 猖獗的虚假信息,自动化起着举足轻重的作用。 它检测并压制虚假信息/假新闻,以维护事实和准确性。

应对拖钓

恶意攻击可能会破坏在线对话并破坏有意义的对话。 自动内容审核可以发现这些巨魔并有助于维持积极的环境。 想象一个教室。 IT 充当了促进建设性互动并为用户提供更好体验的谨慎力量。

深入分析

文本分析不仅仅是关键字检测。 它了解背景并推广真实内容,同时消除有害的叙述。 除了文本之外,图像识别工具还可以检测不适当的视觉效果。 他们确保图像符合平台标准。

全面的视频审核

由于人们喜欢引人入胜的视觉效果,视频内容在数字空间中占据主导地位。 自动化介入以确保这些视频符合特定标准。 它可以筛选大量内容,检测有害元素,并及时将其删除。

结论

自动内容审核既有好处也有挑战。 它擅长从数字平台中删除不合适的内容。 然而,它也面临着局限性,并引发了有关审查制度和技术作用的争论。 在许多情况下,如果出现歧义,还需要人类的专家审核。

平台应该明确审核规则。 他们还需要系统供用户质疑内容删除决策的公平性和准确性。 通过适当的平衡,我们可以实现在线用户的公平,同时维护他们的安全并维护他们的权利。

此方法适用于预定义的禁止或标记单词列表。 当内容包含这些词时,系统要么拒绝其发布,要么将其发送以供审核。 例如,平台可能会阻止与仇恨言论相关的明确语言或术语。

此方法适用于预定义的禁止或标记单词列表。 当内容包含这些词时,系统要么拒绝其发布,要么将其发送以供审核。 例如,平台可能会阻止与仇恨言论相关的明确语言或术语。 该方法利用机器学习的力量,识别不适当或标记的图像。 它可以检测宣扬暴力的视觉内容、露骨内容或受版权保护的材料。 先进的算法分析视觉模式,以确保没有有害图像被忽视。

该方法利用机器学习的力量,识别不适当或标记的图像。 它可以检测宣扬暴力的视觉内容、露骨内容或受版权保护的材料。 先进的算法分析视觉模式,以确保没有有害图像被忽视。

理解内容背后的情绪或情感至关重要。 此方法评估内容基调并标记过于消极、宣扬仇恨或助长有害情绪的内容。 它在促进积极社区互动的论坛或平台中特别有用。

理解内容背后的情绪或情感至关重要。 此方法评估内容基调并标记过于消极、宣扬仇恨或助长有害情绪的内容。 它在促进积极社区互动的论坛或平台中特别有用。 内容通常需要上下文才能准确审核。 此方法评估其周围上下文中的内容。 如果整体上下文无害,它可以确保真实内容(即使带有标记的单词)也不会被错误地阻止。 在示例中 - 它包含“杀戮”一词,在上下文中,它是良性的,指的是玩游戏的无害活动

内容通常需要上下文才能准确审核。 此方法评估其周围上下文中的内容。 如果整体上下文无害,它可以确保真实内容(即使带有标记的单词)也不会被错误地阻止。 在示例中 - 它包含“杀戮”一词,在上下文中,它是良性的,指的是玩游戏的无害活动 有违反准则历史的用户可能需要受到更严格的审查。 该系统根据用户声誉进行调节。 那些有过违规行为的人可能会发现他们的内容比那些干净的人受到更严格的审查。

有违反准则历史的用户可能需要受到更严格的审查。 该系统根据用户声誉进行调节。 那些有过违规行为的人可能会发现他们的内容比那些干净的人受到更严格的审查。 鉴于社交媒体上生成的大量内容,需要专门的工具来监控这些平台。 他们实时检测虚假信息、假新闻或恶意攻击等潜在问题。 它有助于创建一个更清洁、更安全的社交媒体环境。

鉴于社交媒体上生成的大量内容,需要专门的工具来监控这些平台。 他们实时检测虚假信息、假新闻或恶意攻击等潜在问题。 它有助于创建一个更清洁、更安全的社交媒体环境。